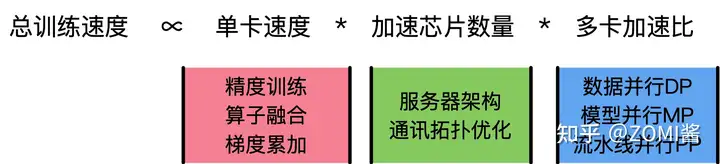

如何利用计算中心成千上百的AI加速芯片的集群,训练参数量超过百亿的大规模模型?并行计算是一种行之有效的方法,除了分布式并行计算相关的技术之外,其实在训练大模型的过程还会融合更多的技术,如新的算法模型架...

大模型工业化的方法论,都藏在GPU里

☁️活动推荐:DataFun五周年直播 ☁️ 直播亮点:发布业界首个数据智能知识地图 ☁️ 观看方式:重磅!业界首个数据智能知识地图发布引言 数据智能时代,计算是刚需,也是痛点,最主要的特点就是一个字...

大模型这场硬仗还得华为昇腾来打

杨净 明敏 发自 凹非寺 量子位 | 公众号 QbitAI为什么这年头,大模型可以这么火?! 这不前几天, 谷歌研究员说“AI有人格”,结果震惊整个科技圈……背后其实就是大模型的锅。 在大家的认知里,...

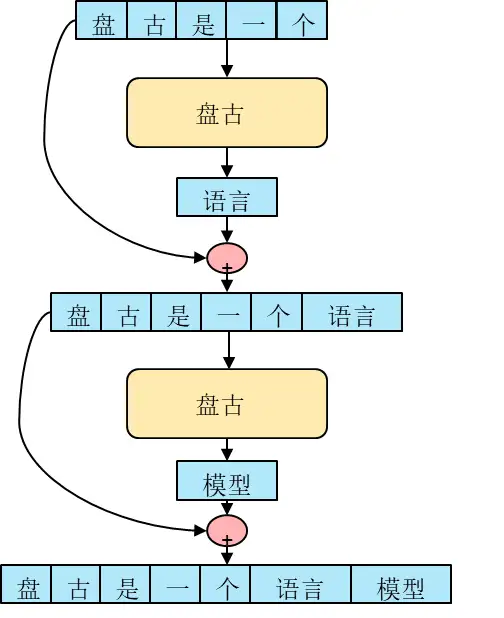

盘古大模型的推理解决方案:增量推理+分布式推理

增量推理鹏程.盘古的基础结构是Transformer的Decoder模块,这种自回归(Auto-regressive)的语言模型会根据上文预测下一个字,因此在推理时会根据输入的文本逐字(词)生成。显然...

推理加速GPT-3超越英伟达方案50%!最新大模型推理系统Energon-AI开源,来自Colossal-AI团队

在前沿AI大模型规模呈指数级增长的趋势下,仅凭单卡已经很难满足当下的推理需求。 就拿拥有1750亿参数的GPT-3来说。 仅仅是加载模型参数就需要数百GB的存储空间,远超单个GPU的容纳能力。 因此,...